ประวัติศาสตร์เทคโนโลยีสอนเราว่า เทคโนโลยีไม่เคยเป็นแค่เครื่องมือ แต่มันคือ ปัจจัยกำหนดอำนาจ (Power Determinant) การมาถึงของยุคอินเทอร์เน็ตเคยสร้างภาพฝันของโลกที่ข้อมูลถูกกระจายอย่างเท่าเทียมและเปิดพื้นที่ให้ทุกคนสามารถ “เข้าถึง” และ “มีเสียง” มากขึ้นได้ แต่เมื่อเวลาผ่านไป ภาพฝันนั้นกลับค่อยๆ ถูกแทนที่ด้วยความจริงอีกแบบหนึ่ง ซึ่งเราอาจไม่ได้เป็นเจ้าของพื้นที่ดิจิทัล หากแต่กำลังถูกขังไว้ในคุกของอัลกอริทึม ที่กำหนดว่าเราจะเห็นอะไร คิดอะไร และเชื่ออะไร โดยมีแพลตฟอร์มอย่าง TikTok และ Instagram เป็นตัวอย่างรูปธรรมที่ชัดเจนในปัจจุบัน

และในวันนี้ คลื่นลูกใหม่อย่างปัญญาประดิษฐ์ (Artificial Intelligence, AI) กำลังยกระดับโครงสร้างอำนาจนี้ไปอีกขั้น โดยเฉพาะในระบบสุขภาพ งานเขียนของ Shoshana Zuboff เรื่อง The Age of Surveillance Capitalism ชี้ให้เห็นชัดเจนว่า ทุนนิยมยุคใหม่ไม่ได้เพียงผลิตสินค้า แต่ผลิต “การทำนายพฤติกรรม” จากข้อมูลของมนุษย์ ผ่านการสร้างระบบเศรษฐกิจที่บริษัทเทคโนโลยียักษ์ใหญ่สามารถเข้าถึงและสะสมข้อมูลสุขภาพของเราโดยแทบไม่มีต้นทุนส่วนเพิ่ม (Near Zero Marginal Cost) ก่อนจะนำข้อมูลเหล่านี้ไปพัฒนาโมเดล AI และเปลี่ยนให้เป็นทรัพย์สินทางปัญญาที่ถูกปล่อยเช่าในราคาสูงลิ่ว

สิ่งที่นึกแล้วน่าขันคือ ข้อมูลที่ถูกสกัดไปจากชีวิตของเรา กลับถูกนำมาบรรจุใหม่ในรูปแบบบริการทางการแพทย์ที่เราต้อง “จ่ายเงิน” เพื่อเข้าถึงอีกครั้ง ซึ่งหมายความว่า “หมอและผู้ป่วยกำลังกลายเป็นผู้ผลิตข้อมูลให้กับระบบที่พวกเขาไม่ได้เป็นเจ้าของหรือเปล่า”

ฟาร์มข้อมูลในยุค AI

หากมองในระดับโลกนั้น ภาพนี้ยิ่งชัดเจนขึ้น หนึ่งในผู้เขียนได้ไปเข้าร่วมการประชุมวิชาการนานาชาติรางวัลสมเด็จเจ้าฟ้ามหิดล (PMAC 2025) ซึ่งเป็นเวทีระดับโลกด้านนโยบายสาธารณสุข (Global Health Policy) ใน Session: Equity and Accountability in Digital Health and AI มีการพูดถึงประเด็นว่า “AI being trained on data from high income countries being given to LMICs as substitute for lack of health workers is a capitalism narrative we don’t want” ซึ่งสะท้อนถึงการขาย AI ให้ประเทศยากจนโดยอ้างว่า "มาช่วยเพราะคุณขาดแคลนหมอ" แท้จริงแล้วคือการ ฉวยโอกาสเชิงโครงสร้าง เพื่อเปลี่ยนการรักษาให้เป็นระบบอัตโนมัติของฟาร์มข้อมูลที่ถูกควบคุมโดยบริษัทข้ามชาติ แทนที่จะลงทุนสร้างบุคลากรจริง ๆ

ดังกรณีของ Babylon Health ในรวันดา นี่คืออุทาหรณ์ของกลุ่มประเทศรายได้น้อย (LMICs) ที่ถูกใช้เป็น "สนามทดลอง" ทุนตะวันตกนำระบบ AI Triage มาติดตั้งโดยอ้างมนุษยธรรม แต่ความจริงคือการใช้คนท้องถิ่นเป็นหนูทดลองเพื่อสูบข้อมูลกลับไปเทรนโมเดลให้สมบูรณ์เพื่อขายในตลาดโลก เมื่อ AI ทำงานผิดพลาดเพราะไม่เข้าใจบริบทพื้นที่ ความเสียหายตกอยู่ที่คนไข้ แต่ความมั่งคั่งตกอยู่ที่เจ้าของแพลตฟอร์ม และนี่คือมายาคติของ "ทุนนิยมการกุศล" (Philanthrocapitalism) ที่เกิดขึ้นกับประเทศกำลังพัฒนาเกือบทั่วโลกไม่ว่าจะเป็นรูปแบบใดรูปแบบหนึ่ง

"อนาคตหมอจะเป็นชนชั้นสร้าง health data ให้ big tech หรือเปล่า

และไทยจะยังคงเป็นฟาร์มแห่งโลก

ที่มี raw resource and labor ชั้นดีไหม"

เมื่อหันกลับมามองบริบทของประเทศไทย เราเองก็อาจกำลังสร้าง "โกดังข้อมูล" ให้เขาเช่าเก็บ "เมล็ดข้อมูล" โดยที่เราไม่มี "โรงงาน" เป็นของตัวเอง ภาวะ Regulatory Capture ในบอร์ด AI ชาติที่ขาดเสียงภาคประชาชน ยิ่งสะท้อนว่าเรากำลังปิดตาข้างหนึ่งต่อโครงสร้างอำนาจที่บิดเบี้ยวนี้ ดังที่ Daron Acemoglu นักเศรษฐศาสตร์รางวัลโนเบลเตือนไว้ใน Power and Progress ว่า "เทคโนโลยีไม่เคยนำมาซึ่งความมั่งคั่งร่วมกันโดยอัตโนมัติ" หากไร้อำนาจในการกำหนดทิศทาง ปัจจุบัน ผู้กำหนดนโยบายไทยกำลังตกอยู่ในหลุมพรางของ "ความสุขระยะสั้น" เราตื่นเต้นกับตัวเลขคำขอลงทุน BOI ด้าน Data Center ที่สูงถึง 2.4 แสนล้านบาท แต่นี่คือภาพลวงตา เพราะข้อมูลจาก UNESCO Readiness Assessment (RAM) เผยว่าเราขาดแคลนบุคลากร AI ถึง 80,000 คน

ประวัติศาสตร์สอนเราว่าไทยเคยเป็น "อู่ข้าวอู่น้ำ" เป็นสังคมเกษตรกรรมที่ส่งออกวัตถุดิบราคาถูกเพื่อนำเข้านวัตกรรมราคาแพง และวันนี้ประวัติศาสตร์กำลังฉายซ้ำในรูปแบบดิจิทัล เราอาจกำลังเปลี่ยนฐานะจากชาวนาในไร่นามาเป็น "ชาวนาดิจิทัล" (Data Farmers) ในลัทธิอาณานิคมข้อมูล (Data Colonialism) ที่ส่งออกทรัพยากรชีวิตคนไทยไปให้ต่างชาติกอบโกย

หรือเงินปันผลจะเป็นคำตอบ

กระนั้น บริษัทยักษ์ใหญ่ย่อมมีข้อโต้แย้งต่อการมองโลกในแง่ร้ายนี้เสมอ หนึ่งในคำตอบที่ถูกหยิบยกขึ้นมาคือแนวคิดเรื่องการคืน “เงินปันผล” ของฟาร์มข้อมูลกลับสู่สังคมในรูปแบบของการแจกรายได้พื้นฐานถ้วนหน้า (Universal Basic Income, UBI) ซึ่งบรรดาผู้นำแห่ง Silicon Valley มักโปรโมทแนวคิดนี้ราวกับเป็น "ยูโทเปีย" พวกเขาวาดฝันว่าเมื่อ AI สามารถสร้างผลผลิตได้แบบไร้ขีดจำกัดและปลดปล่อยมนุษย์จากการทำงานหนัก เพื่อให้เรามีเวลาไปสร้างสรรค์ศิลปะ หรือค้นหาความหมายของชีวิต ภาพฝันนี้ทำให้เราเชื่อว่า กลุ่มทุนเทคโนโลยีกำลังรับบทเป็น "ผู้กอบกู้" ที่หยิบยื่นอิสรภาพมาให้ โดยแลกกับการที่เรายอมถอยออกจากระบบการผลิต

แต่หากเราเจาะลึกด้วยมิติทางประวัติศาสตร์ UBI อาจไม่ใช่สวัสดิการแห่งความเมตตา แต่มันคือ "ขนมปังและละครสัตว์" แห่งศตวรรษที่ 21 เหมือนที่จักรวรรดิโรมันเคยใช้แจกจ่ายอาหารและความบันเทิงเพื่อลดความโกรธแค้นของประชาชนที่ไร้ที่ดินทำกินและตกงาน UBI คือ "ยาชา" ที่ผู้กุมเทคโนโลยี จ่ายเพื่อซื้อความสงบสุข ทำให้คนยอมจำนนต่อการหมดความหมายทางเศรษฐกิจ และยอมเป็นเพียงผู้บริโภค โดยไม่ลุกขึ้นมาตั้งคำถามถึงการกระจายอำนาจที่เป็นธรรม หรือหากมองให้ดีขึ้น UBI ก็อาจเป็น “ค่าเช่า” ที่เจ้าของเทคโนโลยีจ่ายให้กับสังคม เพื่อแลกกับสิทธิในการสกัดมูลค่าจากข้อมูลชีวิตของเราอย่างต่อเนื่อง โดยที่โครงสร้างการถือครองอำนาจยังคงไม่เปลี่ยนแปลง

แต่เมื่อเรานำแนวคิด UBI มาวางลงบนบริบทของประเทศไทย คำถามที่สำคัญยิ่งกว่าก็ปรากฏขึ้น ในเมื่อมูลค่าหลักของเศรษฐกิจ AI ถูกสร้างจากข้อมูลที่ถูกส่งออกไปต่างประเทศ แล้วใครกันแน่คือ “ผู้มีอำนาจ” ในการจ่าย UBI เหล่านั้น ประเทศที่ถือครองแพลตฟอร์ม โมเดล และทรัพย์สินทางปัญญา คือผู้ที่สามารถสกัดและสะสมมูลค่าได้อย่างแท้จริง ขณะที่ประเทศอย่างไทยซึ่งทำหน้าที่เป็นเพียงผู้ผลิต “วัตถุดิบข้อมูล” กลับไม่ได้อยู่ในตำแหน่งที่จะเก็บเกี่ยวผลตอบแทนจากมูลค่านั้นอย่างมีนัยสำคัญ ความเป็นไปได้ของ UBI ในบริบทเช่นนี้จึงไม่เพียงแต่เลือนราง แต่แทบจะเป็นไปไม่ได้ในเชิงโครงสร้าง เพราะรัฐไม่ได้ถือครองแหล่งรายได้ใหม่ที่เกิดจากเศรษฐกิจข้อมูล หากแต่ยังคงพึ่งพาฐานภาษีแบบเดิม ในขณะที่มูลค่าจำนวนมหาศาลไหลออกไปยังบริษัทข้ามชาติอย่างต่อเนื่อง ในท้ายที่สุด เราอาจไม่ได้อยู่ในระบบที่ “แบ่งปันผลประโยชน์” จาก AI แต่กำลังอยู่ในระบบที่เราส่งออกทรัพยากรชีวิตของเราไปสร้างความมั่งคั่งให้ผู้อื่น โดยไม่มีแม้แต่สิทธิ์จะเรียกร้อง “เงินปันผล” กลับคืนมาอย่างแท้จริง

และในมิติที่โหดร้ายกว่านั้น สภาวะนี้ทำให้เรากลายเป็นเหมือนตัวละครใน The Matrix ที่มนุษย์เป็นเพียง "ถ่านไฟฉาย" (Human Batteries) เราไม่ได้เป็นผู้ใช้เทคโนโลยี แต่เราถูกกักขังไว้เพื่อหล่อเลี้ยงระบบด้วยพลังงานจากข้อมูลสุขภาพของเราเอง โดยมีเหล่าเจ้าที่ดินดิจิทัล (Techno-feudal lords) คอยเก็บ "ค่าเช่าทางปัญญา" ในรูปแบบข้อมูลผ่านอัลกอริทึมที่เขาวางกติกาเอง

เราจะมองอนาคตแบบไหน

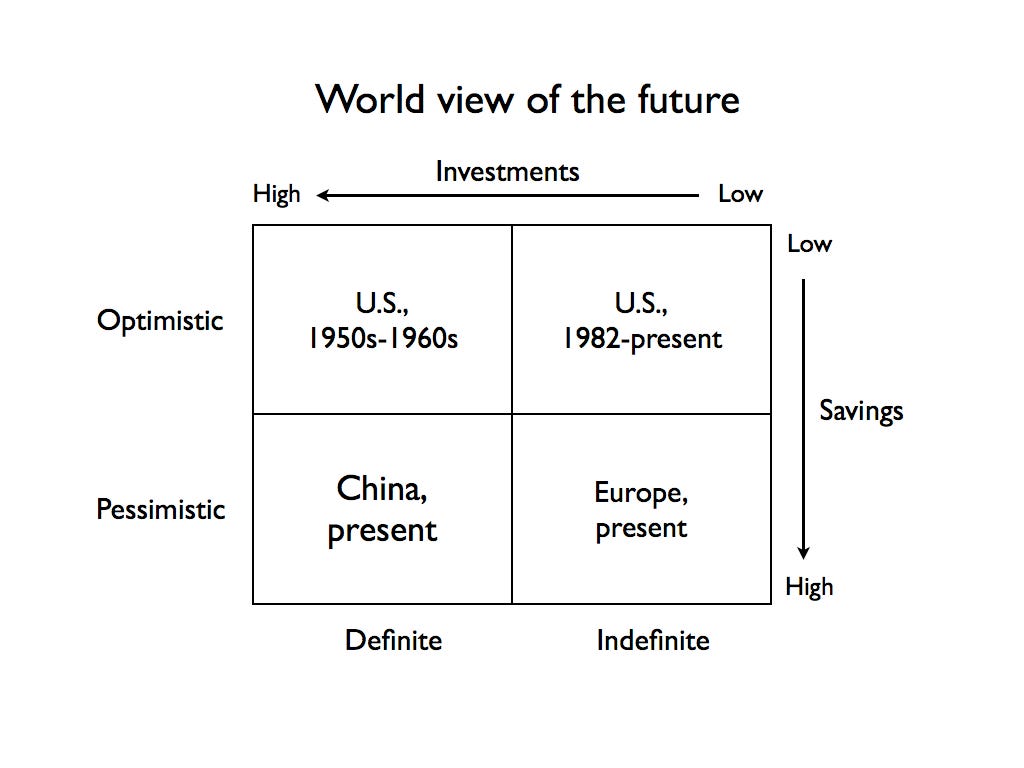

ในหนังสือ Zero to One ของ Peter Thiel ได้แบ่งมุมมองต่ออนาคตของมนุษยชาติออกเป็นตาราง 4 ขั้ว หากเรามองไปที่มหาอำนาจผู้กำหนดเกมของโลก เราจะเห็นยุทธศาสตร์ที่แตกต่างกันอย่างสิ้นเชิง

ในทางกลับกัน สหรัฐอเมริกากลับสะท้อนการเปลี่ยนผ่านจาก Definite Optimism ไปสู่ Indefinite Optimism อย่างชัดเจน ซึ่งในยุค 1950s-1960s อเมริกายุคสร้างชาติหลังสงครามอาจเป็นผู้กำหนดอนาคตที่แท้จริง พวกเขาเชื่อว่าอนาคตจะยิ่งใหญ่ และมีพิมพ์เขียวที่จับต้องได้ เช่น โครงการ Apollo ส่งคนไปดวงจันทร์ (Definite Optimism) แต่ตั้งแต่ช่วงทศวรรษ 1980 เป็นต้นมา วิสัยทัศน์เชิงยุทธศาสตร์ระดับชาติกลับค่อยๆ เลือนหาย รัฐบาลอเมริกันฝากความหวังไว้กับ "กลไกตลาดเสรี" และปล่อยให้บริษัทเทคโนโลยี (Silicon Valley) เป็นคนกำหนดทิศทางอนาคตแทน (Indefinite Optimism) ผลลัพธ์คืออเมริกายังคงเชื่อว่า “อนาคตจะดีขึ้น” แต่ไม่มีใครเป็นผู้กำหนดว่ามันจะดีขึ้นอย่างไร หรือเพื่อใคร

หากเรานำประเทศไทยไปวางในตารางนี้ เราจะพบความจริงที่ว่า เราไม่ได้มีความหวาดระแวงและเตรียมพร้อมรบแบบจีน สังคมไทยตื่นเต้นกับกระแส AI เรายินดีกับตัวเลขคำขอลงทุน Data Center แสนล้าน และเราเชื่อมั่นลึกๆ ว่าเทคโนโลยีจะนำพาความเจริญมาให้ประเทศได้ แต่ความหวังของเรา เป็นความหวังที่ "ไร้พิมพ์เขียว" เราขาดยุทธศาสตร์ที่จะเข้าไปกำกับ ควบคุม หรือแย่งชิงมูลค่าจากเทคโนโลยีเหล่านั้น สิ่งนี้ทำให้ไทยติดหล่มอยู่ใน "Indefinite Optimism" ไม่ต่างจากอเมริกา เราทำตัวเป็นเพียงผู้โดยสารที่นั่งรอให้ Silicon Valley ขับรถพาเราไปสู่อนาคต โดยหวังว่าผลพลอยได้จากเทคโนโลยีจะตกลงมาแก้ปัญหาให้เราเอง

จีนอาจเป็นตัวอย่างของสิ่งที่เรียกว่า “Definite Pessimism” การมองโลกในแง่ร้ายอย่างมีเป้าหมาย กล่าวคือ จีนมองว่าอนาคตคือความโหดร้าย ทรัพยากรมีจำกัด (Pessimistic) แต่ด้วยความหวาดระแวงนี้เอง จีนจึงมี "แผนการที่ชัดเจนและเด็ดขาด" (Definite) พวกเขาสร้าง Great Firewall ดักจับข้อมูลไม่ให้ไหลออกนอกประเทศ ทุ่มสร้าง Sovereign AI ของตัวเอง และใช้รัฐควบคุม Big Tech อย่างเบ็ดเสร็จ จีนไม่ได้รอให้อนาคตเกิดขึ้น แต่พวกเขา "สร้างป้อมปราการ" เพื่อบังคับอนาคตให้เป็นไปตามแผนเพื่อความอยู่รอดของชาติ

ก็เหมือนจะไม่อะไรมาก แต่สำหรับ "ประเทศไทย"

การตกอยู่ในหลุมพราง Indefinite Optimism

คือ "ความตายทางอธิปไตย"

– บางคนอาจบอกว่าเราก็ควรสร้างอธิปไตยขึ้นมา (Sovereign AI) สิ

แต่ด้วยทรัพยากรและงบเราในปัจจุบันจะสู้ได้หรือไม่

เพราะแม้อเมริกาจะปล่อย แต่เขายังมี Big Tech เป็นของตัวเอง ในขณะที่ไทยเราไม่มีอะไรเลย การกระทำเช่นนี้คือการ Loss of Agency เมื่อคุณไม่ได้เป็นคนวาดพิมพ์เขียว คุณก็จะไม่มีอำนาจต่อรองใดๆ เมื่ออนาคตนั้นมาถึง สมองและทรัพยากรของชาติจะถูกดึงไปทำเพียง "นวัตกรรมฉาบฉวย" ที่ปลายน้ำ เพราะไม่มีแผนสร้างอำนาจเชิงลึกชัดเจน

การที่เราเชื่อแบบเลื่อนลอยว่า "เดี๋ยว AI ของฝรั่งก็มาช่วยให้ระบบสาธารณสุขไทยดีขึ้นเองแหละ" คือการเดินหน้าไปเป็นเหยื่อของผู้ที่เขามีแผนยึดครองตลาดไว้แล้ว คุณจะถูกกลืนกินอย่างง่ายดาย เพราะในขณะที่คุณกำลังนั่งรอให้เทคโนโลยีมาช่วยแก้ปัญหา Big Tech ของอเมริกาและจีนก็ได้สร้างกับดัก เช่น กวาดต้อน Data และผูกขาด Compute ไว้รอแล้ว ในท้ายที่สุด เราจะทำอะไรได้ นอกจากยอมตกเป็นหนึ่งในอาณัติของจักรวรรดิข้อมูลที่ยิ่งใหญ่นี้

เราอาจจะต้องเริ่มคิดว่าการพยายามสร้าง AI แข่งกับ Big Tech ที่มีทั้งแต้มต่อด้านทุน ทรัพยากรประมวลผล (Compute) และบุคลากรระดับโลกอาจเป็นการต่อสู้ที่เราเสียเปรียบ และการใช้ “อำนาจเชิงนโยบายและสิทธิขาดเหนือข้อมูล" จะนำเราไปสู่ Definite Optimism ได้ก็ต้องอาศัยเครื่องมือ 2 เสาหลัก

สหกรณ์ข้อมูล (Data Cooperatives) ที่เปลี่ยนวัตถุดิบเป็นทรัพยากรผูกขาดได้ ข้อมูลสุขภาพคนไทยมีความเฉพาะเจาะจงทางชาติพันธุ์ หากเราตั้งสหกรณ์เพื่อทำหน้าที่เป็น "โรงงาน" ให้แพทย์ไทยช่วยแปรรูปและคัดกรอง ข้อมูลดิบจะกลายเป็น Premium Data ที่เราใช้ต่อรองกับ Big Tech เพื่อแลกกับ Technology Transfer สิทธิการใช้งานราคาพิเศษ หรือส่วนแบ่งรายได้ เราต้องขยับสถานะจาก "ผู้ผลิต Data ราคาถูก" ขึ้นไปเป็น "ผู้แปรรูป Data เพื่อสร้างมูลค่าเพิ่ม" (Data Processors & Value-Adders) ยกตัวอย่าง เช่น ถ้าประเทศไทยตั้ง สหกรณ์ข้อมูลโรคเขตร้อน (เช่น โรคไข้เลือดออก หรือ มะเร็งท่อน้ำดี) รวบรวมข้อมูลจากทั่วประเทศ จากนั้นจ้างแพทย์และผู้เชี่ยวชาญชาวไทยทำ Data Labeling (เช่น วงขอบเขตเซลล์มะเร็ง ระบุยีนที่เกี่ยวข้อง) ข้อมูลดิบจะกลายเป็น ชุดข้อมูลเกรดพรีเมียมระดับโลกที่ไม่มีใครมี เมื่อ Big Tech เช่น บริษัทยาหรือผู้พัฒนา AI ทางการแพทย์ ต้องการสร้างโมเดลที่แม่นยำในภูมิภาคนี้ พวกเขาต้องมาเจรจากับสหกรณ์ โดยเราตั้งเงื่อนไขว่า "เราไม่ขายฟรี" แต่แลกกับสิทธิบัตรการค้นพบตัวยาร่วมกัน หรือบังคับว่า AI ที่ฝึกจากข้อมูลชุดนี้ จะต้องให้บริการฟรีหรือในราคาต้นทุนสำหรับโรงพยาบาลรัฐในประเทศไทย

HTA 2.0 คือ การยกระดับการประเมิน AI นอกเหนือจากความแม่นยำทางการแพทย์ ต้องประเมิน "การกระจายมูลค่า" (Value Distribution) ด้วย เพื่อให้มั่นใจว่าการจัดซื้อเทคโนโลยีเหล่านี้จะช่วยสร้างเศรษฐกิจหมุนเวียน การจ้างงานในประเทศ และไม่ทำให้ไทยขาดดุลการค้าเพียงอย่างเดียว

ยกตัวอย่าง "การจัดซื้อ AI คัดกรองเบาหวานขึ้นตา" โรงพยาบาลรัฐกำลังจะซื้อซอฟต์แวร์ AI ประเมินผู้เสนอราคา 2 เจ้า ได้แก่ เจ้า A (นำเข้า 100%) ความแม่นยำ 95% ราคา 10 ล้านบาท (เงินไหลออกนอกประเทศทั้งหมด) และเจ้า B (บริษัทต่างชาติที่ร่วมทุนกับไทย) ความแม่นยำ 93% ราคา 12 ล้านบาท โดยการประเมินแบบเดิม (HTA 1.0) รัฐมักเลือก เจ้า A เพราะถูกกว่าและแม่นยำกว่าเล็กน้อย แต่การประเมินแบบใหม่ (HTA 2.0) นั้น จะต้องจัดตั้งกรรมการจัดซื้อและนำเกณฑ์ "เศรษฐกิจหมุนเวียน" มาคำนวณด้วย และอาจพบว่า เจ้า B แม้จะแพงกว่าและแม่นยำน้อยกว่านิดหน่อย แต่มีการใช้ Local Cloud ของไทย จ้างทีมซัพพอร์ตวิศวกรชาวไทย และสัญญาว่าจะนำกำไร 10% กลับมาลงทุนในกองทุนวิจัยแพทย์ไทย รัฐจึงควรเลือกเจ้า B เพราะเมื่อคำนวณผลประโยชน์ทางเศรษฐกิจ การกระจายที่ตกอยู่กับคนไทย มีมูลค่าสูงกว่าส่วนต่างราคาอย่างมหาศาล

แน่นอน มีหลายคนเสนอว่า "ถ้าเราสู้ระดับโครงสร้าง (Foundation Model) ไม่ได้ เราก็ไปเน้นสร้างแอปพลิเคชัน (Application Layer) ครอบทับโมเดลของเขาเอาสิ" แต่ผู้เขียนเองเชื่อว่าในท้ายที่สุด เราจะถูกกลืนกินอยู่ดี เพราะนี่คือการสร้างบ้านบนที่ดินของคนอื่น วันนี้เราอาจภูมิใจที่วิศวกรและหมอไทยช่วยกันทำแอปพลิเคชันตรวจโรค A ได้สำเร็จ แต่วันใดที่ Big Tech อัปเดตฟีเจอร์ใหม่ โมเดลพื้นฐานของเขาอาจฉลาดขึ้นจนครอบคลุมการวินิจฉัยโรคตั้งแต่ A ถึง Z ได้ด้วยตัวเองเบ็ดเสร็จ แอปพลิเคชันที่คนไทยทุ่มเทสร้างขึ้นจะไร้ความหมายและถูกกวาดล้างไปในข้ามคืน

จุดจบของระบบสุขภาพอาจไม่ใช่ภาพดิสโทเปียที่หุ่นยนต์ติดอาวุธมายึดครองโลกแบบ Skynet แต่มันคือภัยจากมนุษย์ด้วยกันเอง เพื่อจะเข้าใจภัยคุกคามที่หยั่งรากลึกนี้ มหากาพย์วรรณกรรมไซไฟอย่าง "Dune" ของ Frank Herbert ได้ให้คำเตือนที่ทรงพลังที่สุดไว้แล้ว

ในจักรวาลของ Dune มนุษยชาติลุกฮือทำสงครามกวาดล้างเครื่องจักร (Butlerian Jihad) ไม่ใช่เพราะกลัวเครื่องจักรมีชีวิต แต่เพราะตระหนักว่าภัยร้ายที่แท้จริงคือ "คน" ที่แอบซ่อนอยู่หลังเครื่องจักรนั้น ทำให้เกิดบัญญัติศักดิ์สิทธิ์หลังสงครามที่ว่า "จงอย่าสร้างเครื่องจักรให้ละม้ายคล้ายจิตใจมนุษย์" (Thou shalt not make a machine in the likeness of a human mind)

"Once men turned their thinking over to machines

in the hope that this would set them free.

But that only permitted other men

with machines to enslave them."

กาลครั้งหนึ่ง มนุษย์ได้มอบการคิดวิเคราะห์ของตนให้แก่เครื่องจักร

โดยหวังว่ามันจะปลดแอกพวกเขาให้เป็นอิสระ

แต่นั่นกลับเปิดทางให้มนุษย์อีกกลุ่มที่ควบคุมเครื่องจักร

สามารถกดขี่พวกเขาได้

เพราะมนุษย์ในยุคนั้นพึ่งพาเครื่องจักรคิดได้ (Thinking Machines) มากเกินไปจนสูญเสียความสามารถในการคิดและตัดสินใจด้วยตัวเอง ความเกียจคร้านนี้เปิดช่องให้ "มนุษย์กลุ่มน้อย" ที่เป็นเจ้าของและควบคุมเครื่องจักรเหล่านั้น สามารถก้าวขึ้นมากดขี่มนุษยชาติส่วนใหญ่ได้ ... แล้วพบกันในตอนต่อไป

เอกสารอ้างอิง

- Acemoglu, D., & Johnson, S. (2023). Power and Progress: Our Thousand-Year Struggle Over Technology and Prosperity.

- Bereano P. CADTM (2018). Philanthrocapitalism: The Gates Foundation’s African programmes are not charity. Available from: link

- Herbert, F. (1965). Dune.

- National Institute for Health and Care Excellence (NICE). Evidence standards framework (ESF) for digital health technologies / AI.

- Pentland, A. (MIT Media Lab). แนวคิดเรื่อง Data Cooperatives.

- Prince Mahidol Award Conference (PMAC 2025)

- The Wachowskis (Directors). (1999). The Matrix [Film]. Warner Bros

- Thiel, P., & Masters, B. (2014). Zero to One: Notes on Startups, or How to Build the Future.

- UNESCO (2023). Readiness Assessment Methodology (RAM) for AI Ethics.

- Varoufakis, Y. (2023). Technofeudalism: What Killed Capitalism.

- Zuboff, S. (2019). The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power.

- Facebook Post ของคุณ Kanapon Phumratprapin ณ วันที่ 7 กุมภาพันธ์ 2569

- เอกสารแผนปฏิบัติการด้านปัญญาประดิษฐ์แห่งชาติเพื่อการพัฒนาประเทศไทย (พ.ศ. 2565 – 2570)